导读

2026年的地缘政治正被AI重塑。林亦这篇内容揭示了Anthropic与美国军方之间关于“技术红线”的殊死较量。当Claude被卷入斩首行动与情报评估,硅谷的理想主义遭遇了华盛顿的强硬扩张。这场关于算法自主权的博弈,不仅关乎一家公司的命运,更预示着战争形态的根本性转折。

重点

- Anthropic坚持“宪法AI”原则,严禁模型用于大规模监控或脱离人类控制的自主致命性武器系统。

- 美军已在情报分析和模拟作战中深度集成Claude,技术中立性在实战需求面前正面临前所未有的挤压。

- 华盛顿与硅谷的矛盾核心在于AI裁量权:私人公司是否有权在涉及国家安全的算法应用上行使否决权。

备注

科技巨头想做“守门人”,但国家机器只想要“利剑”。林亦提到的“跨越卢比孔河”隐喻极具冲击力,它撕开了技术伦理在暴力机器面前的无力感。在极端地缘压力下,所谓的红线往往只是暂时的妥协,算法完全自主化似乎正成为一种被默许的必然。

一、战事不停

2026 年开年,华盛顿特区的空气里弥漫着一种前所未有的肃杀感。

自从去年川普把“国防部”改名叫“战争部”之后,国际新闻工作者就没消停过。

今年 1 月,美军特种部队跨境突入委内瑞拉,把前总统马杜罗直接从总统府里请到了美国,带他玩了把真人版密室逃脱。

到了 2 月,美军又和以军配合,一发精准导弹,直接把正在开会的伊朗最高领袖送走了。前后不到半小时,整个中东的地缘格局天翻地覆。

这两天,除了战争局势充斥着各大新闻报纸的头条,还有一个硅谷的明星 AI 公司,也跟着被推上了风口浪尖。

今天,咱们就来聊聊:这 AI 和战争是怎么搭上边的?

二、极限拉扯

Anthropic

在伊朗空袭发生的几周前,华盛顿与旧金山之间爆发了一场“内战”。这场冲突的核心,就是硅谷的 AI 巨头 Anthropic 和它的创始人、CEO 达里奥·阿莫迪。

要说阿莫迪这个人,在 AI 圈里绝对算是一号人物了。

他早年在百度、谷歌工作过,还是 OpenAI 创始团队的核心成员,跟着奥特曼一起创办了 OpenAI。

到了 2021 年,他带着一批核心骨干从 OpenAI 出走,创办了 Anthropic。

原因也很好理解,道不同不相为谋。他觉得奥特曼为了商业化,正在放弃 AI 安全的底线,对大模型的风险管控越来越松。

Anthropic 遵守的 “宪法 AI” 就很能体现他的价值观。简单说, AI 是要跟着规矩走的,所有的输出、所有的应用场景,都必须严格遵守这部宪法。而在这部宪法里,有两根红线,是咬死了绝对不能碰的:

第一,绝对不允许将 AI 模型用于对美国公民的大规模监控;

第二,绝对不允许将 AI 模型整合到完全脱离人类控制的自主致命性武器系统中。

他以前就说过:今天的前沿大模型,根本没有达到万无一失的可靠程度,它会出现幻觉,会做出不可预测的错误判断。

把这样的技术,用到没有人类兜底的自主武器上,本质上就是在拿无数人的生命赌运气;

而用它做大规模国内监控,更是在瓦解美国社会制度的根基。

从 2024 年 6 月开始,Claude 就已经在美军的机密系统里运行,给军方做情报分析、文档处理、技术研发,合作了快一年,一直相安无事。

抓捕马杜罗

但这次就不一样了,矛盾的导火索,和 2026 年 1 月抓捕马杜罗的行动有关。

事后有媒体爆出,美军在这次行动里,就是通过和 Palantir 的合作,调用了 Anthropic 的 Claude 模型,完成了情报评估、目标识别、作战场景模拟等核心工作。

消息一出,Anthropic 立刻向军方发去问询,想要确认自己的技术到底被用在了什么地方,有没有触碰自己的红线。

就是这一问,直接点燃了华盛顿和 Anthropic 之间的这场内战。

今年一月,战争部副部长埃米尔·迈克尔(Emil Michael)直接向 Anthropic 隔空喊话,用了一句分量极重的话:“我希望 Anthropic 能够‘跨越卢比孔河’。” 凯撒跨过卢比孔河,就意味着破釜沉舟、再也没有回头的路可以走。

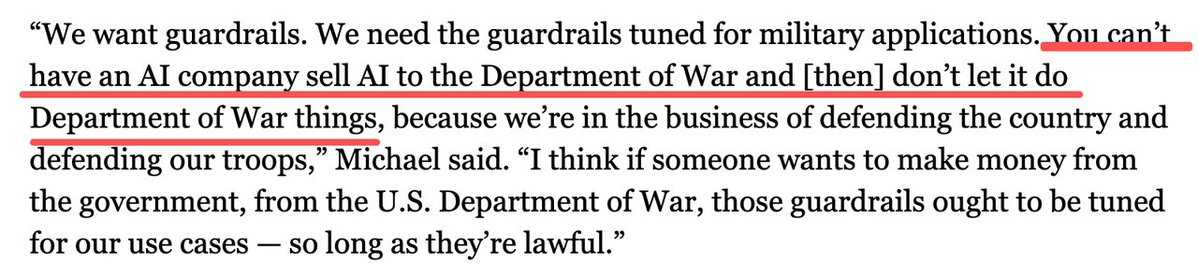

这就相当于公开呼吁 Anthropic 跨越红线,他还认为,私人公司不应在国家安全问题上拥有否决权,现在美国内忧外患,“算法完全自主化”才是唯一的生存路径 。迈克尔的话,直接点出了双方最核心的分歧:到底谁有定义 AI 的最终裁量权?

战争部的逻辑是:美国有完整的法律体系,国会立法、总统签字、军方执行,什么事合法、什么事违法,法律说了算。你一个私人企业,凭什么给美国军方定规矩,甚至对军事行动行使所谓的“否决权”?这是将资本凌驾于国家权力之上。

而 Anthropic 的逻辑,和我们刚才说的一样:法律有太多模糊地带,更何况,军方口中的 “合法”,是可以随着政策、随着法律修订而改变的。今天法律禁止大规模监控,明天就可能改弦更张;今天政策要求自主武器必须有人类兜底,明天就可能为了应对所谓的 “紧急威胁” 放开限制。

最后通牒

2026 年 2 月 25 日,战争部长皮特·海格塞斯直接给阿莫迪下达了最后通牒:2 月 27 日周五下午 5 点 01 分之前,Anthropic 必须移除其服务条款中的所谓“红线”,否则,就将被列为“供应链风险”,给你点颜色看看。

要知道,这个帽子一般都是给海外公司用的,比如俄罗斯的卡巴斯基实验室。从来没有一家美国本土公司,被贴上过这个标签。一旦被贴上,所有和美国军方有合作的承包商、供应商、合作伙伴,都不得和这家公司有任何商业往来。

Anthropic 现在正处在业务的爆发期,Claude 代码工具成了全球无数科技公司、软件企业的首选。这个标签一旦贴实,就等于直接断了 Anthropic 的生路。

2026 年 2 月 26 日,Claude 的母公司 Anthropic 专门发了一篇驳斥他的文章,依旧要坚持两条核心红线不动摇。

白宫的怒火

这下彻底激怒了白宫。

特朗普亲自下场,毫不吝啬对 Anthropic 一番“赞美”:说它是“左翼分子”、“将自己凌驾于合众国宪法之上”、“置美国士兵的生命于不顾”。

随即,白宫发布命令,也就是在空袭前几个小时,要求所有联邦机构停止使用 Anthropic 的产品。

这个时间点就很难不让人遐想,说白了,Anthropic 的极速切割,似乎印证了一件事:这次伊朗事件,似乎正是 Claude 模型,帮助美军完成了情报评估、目标识别与作战场景模拟等任务。

具体应用到什么程度,自然是绝密中的绝密,但 AI 应用于军事领域这件事,确实是板上钉钉的。

三、杀鸡儆猴

OpenAI

这场决裂,到这里已经没有任何缓和的余地,白宫这场“杀鸡儆猴”的戏码,也很快收到了成效。

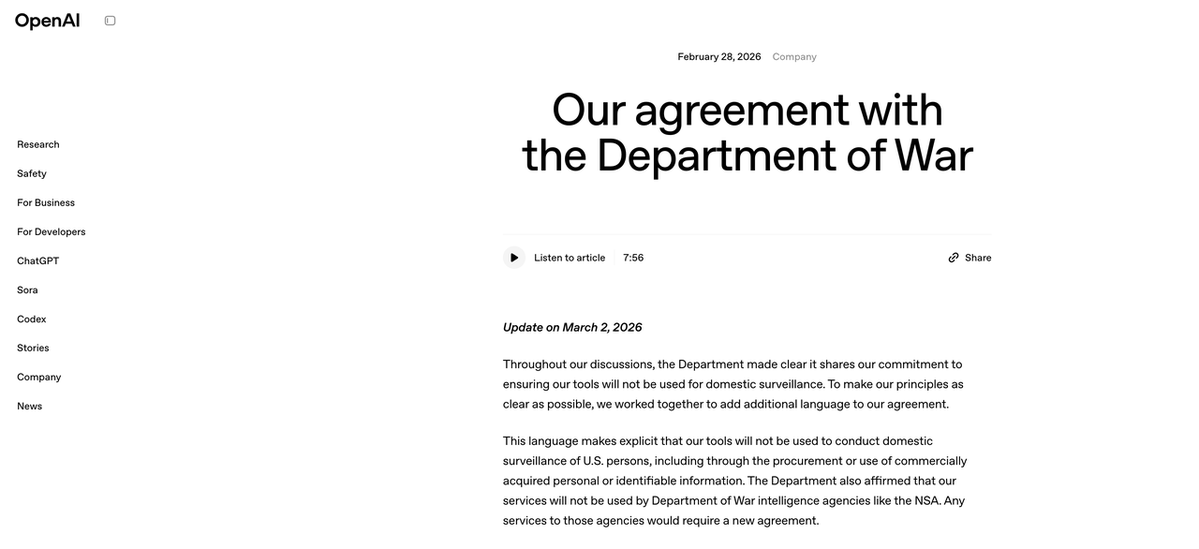

就在 Anthropic 被正式封杀的第二天,2026 年 2 月 28 日,OpenAI 突然发布了一篇公告,标题就叫《我们与战争部的协议》。

这个时间点,简直是把 “投名状” 三个字写在了明面上。而更有意思的是,OpenAI 在公告里说,自己和战争部的协议里,也设置了三条核心红线,和 Anthropic 的两条红线几乎如出一辙:

1.不将 OpenAI 的技术用于大规模国内监控;

2.不将 OpenAI 的技术用于指挥自主武器系统;

3.不将 OpenAI 的技术用于高风险的自动化决策,比如社会信用体系。

协议的内容

既然红线都差不多,为什么 Anthropic 被封杀,OpenAI 却能和军方达成合作?难道真的是阿莫迪不识时务,奥特曼更懂谈判吗?

先看 OpenAI 的协议,它做了三个关键的设计,而这三个设计,恰恰是 Anthropic 打死都不肯接受的。

第一,云部署架构,但把决定权留在自己手里。OpenAI 的协议里明确,模型只做云部署,不提供给军方无护栏的模型,也不部署在边缘设备上。这里的关键是,自主武器系统要在战场上实时反应,必须要把模型部署在武器自身(即边缘设备)上,云部署有网络延迟,根本撑不起实战场景。OpenAI 用这个方式,从技术上就堵死了模型被用于自主武器的可能,也给了军方一个台阶,不是我 OpenAI 不让你用,是技术架构不支持;

第二,保留完整的安全栈控制权。OpenAI 在协议里说,自己会保留对安全防护系统的完全自由裁量权,会有通过军方安全审查的 OpenAI 工程师、安全研究员,全程参与模型的使用和监管。简单说,模型怎么个跑法、安全护栏怎么设置,还是 OpenAI 说了算;

第三,就算未来法律改了,也不算数。OpenAI 的合同里,明确引用了当前美国关于监控、自主武器的法律和政策,白纸黑字写清楚:就算未来这些法律、政策改了,模型的使用,也必须遵守协议签订时的标准。

而这三点,也恰恰是 Anthropic 之前和军方谈判时,军方始终不肯答应的。Anthropic 的发言人曾说,军方给的协议里,那些所谓的法律保障,旁边全是配套的法律术语,最终的结果就是,军方可以随时、随意地无视这些保障。

为什么OpenAI可以?

那为什么军方对 OpenAI 松口了呢?

说白了,还是 Anthropic 的硬刚,给 OpenAI 铺了路。白宫刚把不配合的 Anthropic 打成了 “反面典型”,急需一个正面榜样站出来,也给硅谷其他公司一个示范:只要你愿意坐下来谈,条件什么的都好说。

更有意思的是奥特曼和阿莫迪的恩怨。

两个人本是 OpenAI 的同门师兄弟,当年阿莫迪出走,就是看不惯奥特曼在 AI 安全上的妥协;如今,一个因为坚守红线被政府封杀,一个靠着灵活变通,拿下了美国军方这个全球最大的客户,两个人的人生轨迹,因为 AI 军事化这场大戏,似乎走向了完全相反的方向。

就连 OpenAI 自己,都在公告里明确表态:“我们不认为 Anthropic 应该被列为供应链风险,我们已经把这个立场明确告知了政府。”

这情商也是拉满了。

xAI

如果说 OpenAI 是“犹抱琵琶半遮面”,给了军方一个体面的台阶下,那马斯克和他的 xAI,就更为激进。

就在 Anthropic 被封杀的同一天,马斯克就在社交媒体上公开为白宫的决定喝彩,直接骂 Anthropic 和阿莫迪 “憎恨西方文明”,认为其标榜的道德准则本质上是要解除西方国家的武装,做“投降派”。

马斯克之所以敢如此叫板,是因为他旗下的 xAI,从一开始就接受了战争部的要求,没有设置任何额外的红线。而军方之所以对马斯克的 Grok 模型青睐有加,不仅仅是因为他“听话”,更是因为他手里有一张王牌,星链。

马斯克承诺,会把 SpaceX 星链的全球数据,和 xAI 的计算能力打通,给军方打造一个能够覆盖全球、实时抓取全网公开情报的巨型 AI 侦察系统。

简单说,全球任何一个角落的社交媒体动态、监控画面、卫星数据,只要星链能覆盖到,Grok 就能想办法分析、筛选、定位,给军方提供精准的情报,这种能力,恰恰是美军在全球作战里最需要的。

站在这个节骨眼,这三家硅谷的 AI 巨头,走向了截然不同的方向

一边是宁死不屈、被封杀的 Anthropic;

一边是有条件妥协、拿下军方大单的 OpenAI;

一边是一路狂奔的 xAI。

硅谷的三大 AI 巨头,在 AI 军事化这个十字路口,做出了完全不同的选择。在国家机器的强权和巨大的商业利益面前,AI 安全的理想,似乎没那么统一。

四、AI 军火商

Palantir

就在 Anthropic 被封杀、OpenAI 和 xAI 争相和白宫合作的时候,一批专门为军事而生的 AI 军火商,也又一次被推到了风口浪尖。

这些公司唯一的目标,就是用 AI 帮忙打赢战争。

其中最具代表性的,就是彼得・泰尔联合创立的 Palantir。

Anthropic 的 Claude 模型,之所以能被用到委内瑞拉的军事行动里,就是通过 Palantir 的合同。

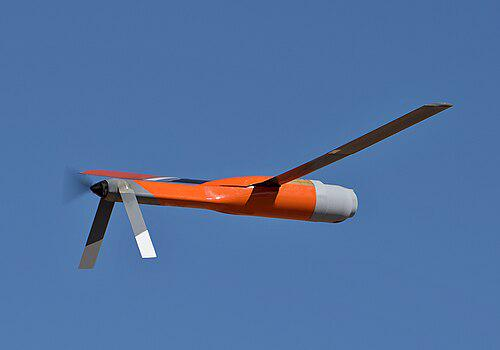

Palantir 是美军事实上的 AI 操作系统,它手里的 Maven,是美军当前最核心的智能作战指挥系统。

Maven 系统能把全球的卫星图像、无人机实时画面、地面传感器数据、无线电监听信息、公开情报,全部整合到一个统一的决策界面里,用 AI 算法完成实时分析、目标识别、轨迹预判,直接把 “发现目标” 到 “下达摧毁指令” 的时间,压缩到了几分钟。

之前说到,让谷歌 DeepMind 员工集体抗议的,就是这个智能系统。

Palantir 从创立的第一天起,就是为美国情报机构和军方服务的。911 事件之后,CIA 就是借助 Palantir 的系统,从海量数据里找到了恐怖分子的踪迹,锁定了本・拉登的位置。

如今,它靠着一份价值 100 亿美元的美国陆军合同,彻底成了美军作战系统的底层架构。

Anduril

还有一家公司,在 Anthropic 被下课的当晚,身价也跟着水涨船高,它就是 Anduril 工业。毕竟,腾出来的市场,对这些专职的 AI 军火商是重大利好。

Anduril 的创始人帕尔默・拉基,92 年出生, 是 VR 设备 Oculus 的创始人,21 岁那年被 Facebook 以 20 亿美元和分红的优厚条件收购。

17 年,帕尔默因为向一个支持特朗普、反对希拉里的组织捐赠一万美元引发争议,被 Facebook 开除。随后,他转身创办 Anduril,一门心思做军事 AI。

这家公司的核心产品,全是 AI 驱动的自主作战系统:从负责边境监控的 AI 哨兵、到反无人机的自主防御系统、再到控制无人机蜂群的 AI 算法,只要军方需要,它就能做。

说到这些 AI 军火商的崛起,就又扣回了特朗普的军事政策:政府封杀 Anthropic,不是真的缺它这一个 AI 模型。

而是要借着这件事,给全美国的 AI 公司立一个规矩:在 AI 军事化这件事上,没有中立的选项,要么站在我们这边,要么就被我们淘汰。

AI 就是未来全球霸权的核心,军事上的 AI 优势,就是美国全球霸权的基础。任何试图给 AI 设限的行为,都是在损害美国的国家利益,都是在向对手妥协。

五、未来的答案

故事讲到这里,关于 AI 战争伦理的讨论,还远没有终结。

70 多年前,奥本海默站在三位一体核试验场的蘑菇云前,想起了《薄伽梵歌》里的那句话:

“我现在成了死神,世界的毁灭者。”

"Now, I am become Death, the destroyer of worlds."

他亲手造出了原子弹,却用自己的余生反对核扩散、反对核武器的滥用。可是,他终究没能拦住。

核扩散的洪流,还是席卷了整个世界。

而今天,我们似乎,正站在和当年一模一样的十字路口。

AI,就是这个时代的原子弹,它的威力,甚至比核武器更可怕、更无孔不入。

在国际法学者和部分 AI 专家看来,人类士兵在战场上具有一种极其宝贵的品质,犹豫。

这种犹豫并非由于懦弱,而是源于对生命价值的道德审视和对法律边界的直觉感知。

然而,战争是残酷的,战争发动者追求的是最大化杀伤和自动化决策,本质上是在通过算法,一步步消除这种犹豫空间。

当 AI 可以自主指挥成千上万的无人机发动袭击,人类在战争里,还能剩下什么呢?是算法里的一个目标坐标?还是伤亡数字里的一个统计单位?

奥本海默曾说:

“科学家已经认识到了罪恶。”

"The physicists have known sin. "

而今天的 AI 从业者,正在面对同样的拷问。

当你写下的一行行代码,最终可能变成夺走生命的武器;

当你训练的 AI 模型,最终可能成为监控社会的工具;

当你创造的技术,最终可能把人类带向不可预知的未来,你又会怎么选择?

是选择跨越那条卢比孔河?还是选择守住底线,哪怕要面对灭顶之灾?

这个问题的答案,不仅决定了 AI 的未来,更决定了人类的未来。

参考资料:

Statement from Dario Amodei on our discussions with the Department of War – Anthropic

U.S. Strikes in Middle East Use Anthropic, Hours After Trump Ban – WSJ

Our agreement with the Department of War – OpenAI

Maven Smart System – MDAA

编辑评论

这篇《X 导入:林亦LYi – 人工智能,已经在帮人类打仗了吗?》来自 X 社交平台,作者为 林亦LYi。从内容完整度看,原文给出的关键信息密度较高,尤其在核心结论和行动建议上有较强的可执行性。一、战事不停 2026 年开年,华盛顿特区的空气里弥漫着一种前所未有的肃杀感。 自从去年川普把“国防部”改名叫“战争部”之后,国际新闻工作者就没消停过。 今年 1 月,美军特种部队跨境突入委内瑞拉,把前总统马杜罗直接从总统府里请到了美国,带他玩了把真人版密室逃脱。 到了 2 月,美军又和以军配合,一发精准导弹,直接把正在开会的伊朗最高领袖送走了。前后不到半小…。对读者来说,它最直接的价值不是“知道一个新观点”,而是能快速看到该观点背后的条件、边界和潜在代价。 如果把这篇内容拆成可验证的判断,至少包含以下层面:2026 年开年,华盛顿特区的空气里弥漫着一种前所未有的肃杀感。;自从去年川普把“国防部”改名叫“战争部”之后,国际新闻工作者就没消停过。。这些判断中,结论部分往往最容易传播,但真正决定实用性的,是前提假设是否成立、样本是否足够、时间窗口是否匹配。我们建议读者在引用这类信息时,优先核对数据来源、发布时间和是否存在平台环境差异,避免把“场景化经验”误当作“普遍规律”。 从行业影响角度看,这类内容通常会对产品策略、运营节奏和资源投入产生短期引导作用,尤其在 AI、开发工具、增长和商业化等主题里更明显。站在编辑视角,我们更关注“它是否能经受后续事实检验”:一是结果能否复现,二是方法能否迁移,三是成本是否可承受。来源为 x.com,建议读者将其作为决策输入之一,而不是唯一依据。 最后给出一个实操建议:如果你准备据此行动,可以先做小范围验证,再根据反馈逐步扩大投入;若原文涉及收益、政策、合规或平台规则,请以官方最新公告为准,并保留回滚方案。转载的意义在于提高信息流通效率,但内容价值真正形成于二次判断与本地化实践。基于这一原则,本文配套的编辑评论会持续强调可验证性、边界意识与风险控制,帮助你把“看到的信息”变成“可以落地的认知”。